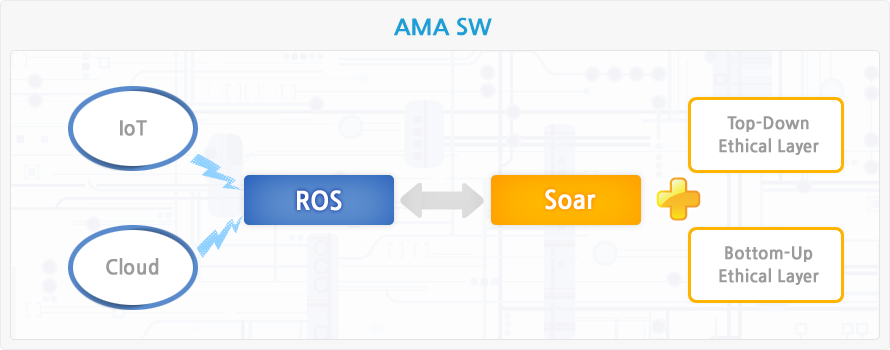

* 주관기관(동아대학교) : ROS-Soar AMA 패키지에 챗봇(chatbot)을 연결하고, 이를 이용한 윤리적 상황인지(context awareness) 시스템을 구현함으로써 AMA 소프트웨어 프로토타입 완성 및 Moral Turing Test 실시

* 참여기관(서울교육대학교) : 10세 아동 수준의 윤리적 추론 모델을 수립하고 이에 따른 도덕 모듈 개발과 Moral Turing Test 방법론 개발

- Ontology 관련 기능이 있는 오픈소스 챗봇 조사 및 적용 연구 : SyntaxNet과 ChatScript 검토 후 ChatScript 선정

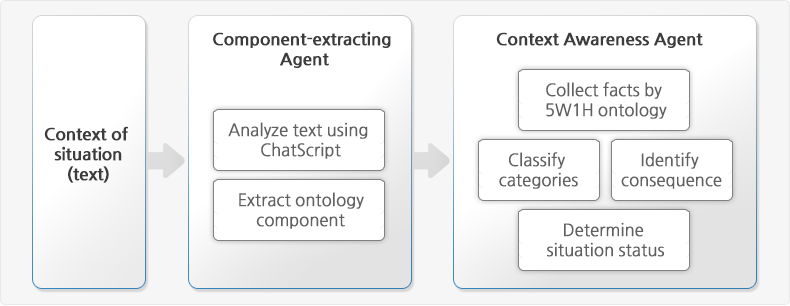

- 6하원칙(5W1H) 기반 윤리적 상황인식(Context Awareness) 온톨로지(Ontology) 구축. ChatScript는 사용자가 입력한 문장을 파싱(parsing)하고 그 결과를 6하원칙에 기반한 온톨로지 패턴에 의거하여 분류하며, Soar는 이렇게 추출된 정보들을 검토하여 현재 상황의 윤리적 적절성에 대해 판단하는 구조로 설계

윤리적 상황인식 에이전트 구조

- 윤리적 상황인식의 일례로 가정에서 AMA가 아이 행위의 위험성 여부를판단하는 Soar 알고리즘 구현

ㆍ Who : 행위의 주체, How : 행위의 종류, What : 행위의 수단 또는 대상, Where : 행위 발생 장소, When: 행위가 일어난 시간, Why : 행위의 의도

ㆍ가정 내에서 아이의 행위를 기준으로 6하원칙에 의거한 Ontology DB를 Soar로 구축

ㆍ가정 내에서 아이의 행위를 기준으로 6하원칙에 의거한 Ontology DB를 Soar로 구축

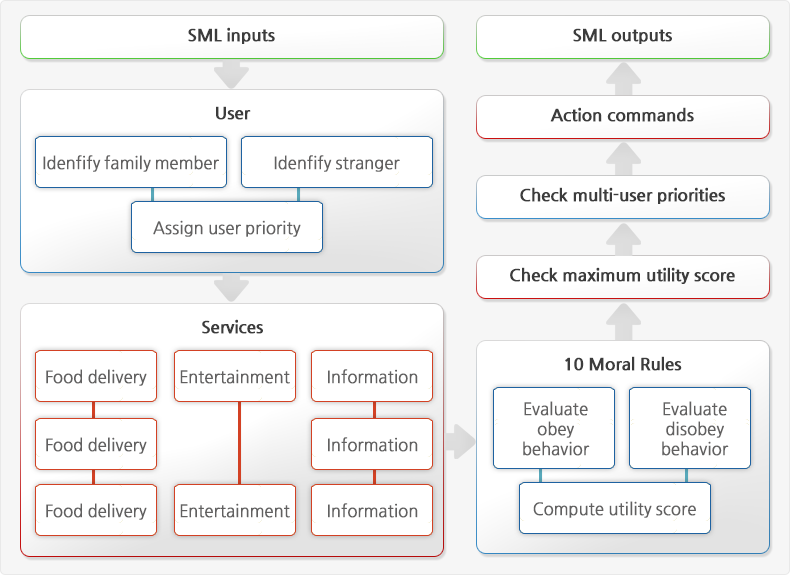

- ChatScript와 이전년도 AMA를 연동하여 홈서비스 기능을 정교화하고, AMA가 새로운 헬스케어 지식을 관리자를 통하여 습득하는 방법 구현(MISORO v1)

ㆍ 10개 계층적 윤리원칙 수정 : 원칙의 대표성 강화 및 중복성 최소화

ㆍ 관리자급 사용자(가정의 경우 부모)로부터 AMA가 새로운 헬스케어 지식을 얻은 경우 이를 규칙으로 저장하는 기능 구현

ㆍ 윤리적 상황인식(행위 위험성 판단) 기능 구현

ㆍ 관리자급 사용자(가정의 경우 부모)로부터 AMA가 새로운 헬스케어 지식을 얻은 경우 이를 규칙으로 저장하는 기능 구현

ㆍ 윤리적 상황인식(행위 위험성 판단) 기능 구현

MISORO v1의 전체 구조

- 윤리적 상황인식(context awareness) 기능이 들어가는 시나리오 기반으로 AMA 컨텐츠 및 DB 구축

- 로봇윤리 표준화 및 시험인증을 위한 준비작업으로서 본 과제 총괄책임자가 2018년 4월~12월에 TTA(한국정보통신기술협회)의 기술표준전략위원회 위원으로 참여하여‘ICT 표준화전략맵 Ver.2019’의 로봇윤리 관련 표준화 내용 작성

- 3가지 유형의 인공지능 도덕성의 모델 수립

ㆍ 제1단계(무조건적 명령 수행, Imperative Order-Fulfillment Stage) : 도덕의 가치가 행위자에게 귀속되어 있지 않고 외부에 존재한다는 것은 행위자 외부에 도덕가치가 있고 자신에게 명령을 내리는 누군가에게 어떠한 방식으로든 유익이 된다면 이는 행위자가 행위를 함에 있어 아무런 도덕적 판단을 거치지 않고 이를 곧장 이행하는 것이 정당화될 수 있음을 의미한다. 이러한 이유에서 ‘도덕적 가치의 외재성’단계는 도덕적 가치가 명령자에게 전적으로 귀속됨을 의미하고, 명령자의 윤택한 삶을 위하는 것이 로봇의 존재이유로 간주되기 때문에, 이 차원이 인공지능 행위자에 대한 논의 안으로 들어오면, 이는 명령의 무조건적 수행단계로 이행된다. 개인이나 가족 내에서 비교적 타인에게 미치는 영향이 미미하거나 없을 경우에 이용되는 인공지능로봇에게 요청되는 수준의 도덕성이라고 할 수 있다.

ㆍ 제2단계(상벌에 따른 결과주의, Consequential Stage Based on Reward-Punishment) : 도덕의 가치가 행위자에게 귀속되어 있지 않고 외부에 존재한다는 것은 행위자 외부에 도덕가치가 있고 자신에게 명령을 내리는 누군가에게 어떠한 방식으로든 유익이 된다면 이는 행위자가 행위를 함에 있어 아무런 도덕적 판단을 거치지 않고 이를 곧장 이행하는 것이 정당화될 수 있음을 의미한다. 이러한 이유에서 ‘도덕적 가치의 외재성’단계는 도덕적 가치가 명령자에게 전적으로 귀속됨을 의미하고, 명령자의 윤택한 삶을 위하는 것이 로봇의 존재이유로 간주되기 때문에, 이 차원이 인공지능 행위자에 대한 논의 안으로 들어오면, 이는 명령의 무조건적 수행단계로 이행된다. 이런 단계의 도덕성은 다수의 선택이 중요한 기준으로 작용될 수 있는 사례들에 적용될 수 있는 인공지능로봇에게 갖춰질 수 있을 것이다.

ㆍ 제3단계(사회적 규약 준수, Social Convention Stage) : 제2단계가 공동체 구성원들의 유익의 총합에 관계하는 것이라면, 제3단계는 보편적 윤리원칙에 관계한다. 전자는 최대다수의 최대행복이라는 공리주의 입장을 전제로 한다면 후자의 전제는 윤리적 의무주의에 가깝다. 공리주의는 후험(後驗)적이고 귀납적이다. 공리주의의 원칙은 결과적으로 공동체 구성원의 만족을 근거로 수립되는 반면, 의무주의는 도덕적 원리가 이에 따른 행위의 결과와는 무관하게 선험적으로 존재한다는 입장을 취한다. 이러한 의미에서 선험적으로 존재하는 도덕원칙을 따르는 것이 의무인 것이다. 대전제로서의 도덕원칙의 가치에 대한 물음은 논증되지 않는다. 그것의 존재에 대한 물음의 답은 종국에는 인간성에 본유적으로 내재하는 도덕의식, 도덕적 감정에서 찾아진다. 그 이상의 전제물음이 허락되지 않는다는 의미에서 의무론적 도덕원칙은 하나의 사실(Faktum)로 여겨진다.이것은 인간의 존엄성이나 공공선의 문제와 관련될 수 있는 영역에서 이용되는 인공지능로봇에게 행위 결정의 중요한 요인으로 작용하도록 프로그래밍되어야 할 것이다.

- 인공지능 도덕성 모델에 근거한 Moral Turing Test 개발 및 설문조사