ЗЮКПРЧ ОюПјРК УМФкРЧ БиРлАЁРЮ ФЋЗМ ТїЦх(Karel Capek)РЬ 1920ГтПЁ ЙпЧЅЧб 'Rossum's Universal Robots'ЖѓДТ ШёАюПЁМ УМФкОюЗЮ 'АСІЗЮ РЯЧЯДй'ЖѓДТ ЖцРЮ robotaЖѓДТ ДмОюИІ ЛчПыЧиМ РЯИИ ПНЩШї ЧЯДТ РЮСЖРЮАЃРЛ СіФЊЧб ЕЅМ РЏЗЁЧбДй.

РЬУГЗГ ЗЮКПРК ЛчЖїРЛ ДыНХЧиМ ДмСЖЗгАХГЊ, РЇЧшЧЯАХГЊ, РлОїШЏАцРЬ ПОЧЧЯАХГЊ, ХЋ ШћРЬ ЧЪПфЧб РЯРЛ ЙнКЙРћРЬИщМ СЄШЎЧЯАд Рп Чв Мі РжЕЕЗЯ ВїРгОјРЬ ПЌБИАГЙпЕЧОю ПдДй.

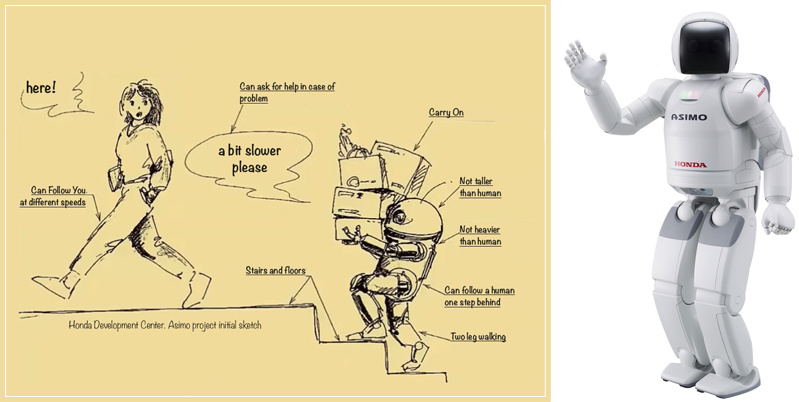

ОЦЗЁРЧ ЛчСјРК ММАшУжУЪЗЮ ОШСЄРћРЮ РЬСЗКИЧрРЬ АЁДЩЧб ШоИгГыРЬЕх ЗЮКПРЬОњДј HondaЛчРЧ ASIMOПЭ РЬ ЗЮКПРЛ БтШЙЧв ДчНУ ПЌБИПјЕщРЧ НКФЩФЁРЮЕЅ, ЛчЖїРЛ ДыНХЧиМ ШћЕч РЯРЛ ЧЯДТ АЭРЬ РЬ ЗЮКПРЧ АГЙп ИёРћРгРЛ Рп КИПЉСжАэ РжДй.

РЬСІ ЛчЖїЕщРК АјРхПЁМ ЛчЖїДыНХ ШћЕч РЯРЛ УДУД ЧиГЛДТ ЛъОїПы ЗЮКП ЛгИИ ОЦДЯЖѓ РЯЛѓЛ§ШАПЁМ ЧдВВ СіГО Мі РжДТ ДйРчДйДЩЧЯАэ ФЃМїЧб ЗЮКПРЛ СЁСЁ Дѕ ЧЪПфЗЮ ЧЯАэ РжДй.

Бз АсАњ ОЦЗЁ ЛчСјПЁМУГЗГ ЛчЖїАњ ДыШЧЯАэ, ПјЧЯДТ СЄКИИІ ОЫЗССжАэ, ЧЪПфЧб МКёНКИІ СІАјЧиСжАэ, ИжИЎ ЖГОюСј АїПЁМ ЛчЖї ДыНХ ШИРЧПЁ ТќПЉЧЯАэ, РќРяХЭПЁМ РЇЧшЧб ЦјЙпЙАРЛ СІАХЧЯАэ, НЩСіОюДТ ЛчЖї ДыНХ РкРВРћРИЗЮ ПюРќЧЯПЉ ОШРќЧЯАд ИёРћСіБюСі ЕЅЗСДй СжДТ ЗЮКП БтМњЕщРЬ МгМг ЧіНЧШЕЧОю АЁАэ РжДй.

РЬЗИАд ПьИЎ РЮАЃЕщРЬ ЛьАэ РжДТ АјАЃПЁ ЗЮКПРЬ КвОІ ЕщОюПТДйИщ ПьИЎДТ ЗЮКПРЛ ОюЖВ СИРчЗЮ ЙоОЦЕщРЬАд ЕЩБю?

УГРНПЁДТ ЗЮКПРЬ ОюЛіЧЯАэ ГИМГАкСіИИ, ДУ БзЗЁПдЕэРЬ ПьИЎДТ ЗЮКППЁ ДыЧи ГЊИЇРЧ СЄРЧИІ ЧЯАэ А№ РЭМїЧиСЎМ ЗЮКПРЛ ЛчЖїЕЕ ЕПЙАЕЕ ОЦДб СІ3РЧ СИРч(СиРЮАнУМ)ЗЮ АЃСжЧЯАд ЕЩ АЭРЬДй.

БзИЎАэ РкНХЕЕ И№ИЃАд ЗЮКПРЬ РЮАЃУГЗГ Л§АЂЧЯАэ ИЛЧЯАэ ЧрЕПЧЯБтИІ БтДыЧв АЭРЬДй.

РЬДТ КЛСњРћРИЗЮ ЗЮКПРЬ УжМвЧбРЧ ПЙР§Ањ ЛчШИЁЄЙЎШРћ МвОч, ЕЕДіМКРЛ АЎУт АЭРЛ ПфБИЧЯДТ АЭАњ ААРИИч, ЗЮКПРЬ БзЗЏЧб БтДыИІ РњЙіИБ ЖЇ ЛчЖїЕщРЬ ДРГЂДТ НЧИСАЈАњ УцАн, ЕЮЗСПђРК ЖЧ ДйИЅ ЛчШИРћ ЙЎСІИІ ОпБтЧв МіЕЕ РжДй.

РЬЗЏЧб БйПјРћРЮ ЙЎСІПЁ ДыРРЧЯБт РЇЧи РќММАшРћРИЗЮ УжБйПЁ НУРл ЕШ ПЌБИАЁ ЙйЗЮ РЮАјРБИЎПЁРЬРќЦЎ(Artificial Moral Agent) БтМњЗЮМ, РЬ БтМњРЛ ЗЮКППЁ РћПыЧЯИщ ЗЮКПРЬ ОжИХЧЯАХГЊ КЙРтЧб ЛѓШВПЁМ ЛчЖїРЬ ГГЕцЧвИИЧб ЕЕДіРћ АсСЄРЛ НКНКЗЮ ГЛИБ Мі РжАд ЕШДй.

БзЗЏГЊ ЗЮКПРЬ ЕЕДіРћ АсСЄРЛ НКНКЗЮ ГЛИЎДТ АЭРЛ ЙоОЦЕщРЬБт РЇЧиМДТ МіИЙРК ДмАшРЧ РЬЗаРћ ПЌБИПЭ БтМњ АГЙп, БзИЎАэ АЂ КаОп РќЙЎАЁПЭ ЛчШИРћ ИЎДѕЕщ АЃРЧ ЧеРЧАЁ ЧЪПфЧб НЧСЄРЬДй.

РЬ ЛчРЬЦЎДТ ЕПОЦДыЧаБГ РќРкАјЧаАњРЧ БшСОПэ БГМі ЦРАњ МПяБГРАДыЧаБГ РБИЎБГРААњРЧ КЏМјПы БГМі ЦР, БзИЎАэ АЂ КаОпРЧ МіИЙРК РќЙЎАЁЕщРЬ ЧеНЩЧЯПЉ 2016ГтКЮХЭ 2021ГтБюСі ИИ10ММ ОюИАРЬ МіСиРЧ РБИЎРћ ЦЧДмРЛ Чв Мі РжДТ РЮАјРБИЎ ПЁРЬРќЦЎИІ ПРЧТМвНКЗЮ ЧдВВ АГЙпЧЯДТ АњСЄРЛ Л§Л§ЧЯАд БтЗЯЧЯАэ, Бз АњСЄПЁМ АГЙпЕЧДТ МвНКФкЕхПЭ БтМњЕщРЛ АјРЏЧЯИч, МіИЙРК ЛчЖїЕщРЧ ДйОчЧб РЧАпРЛ МіЗХЧЯДТ РхРЬ ЕЩ АЭРЬДй.

ЧЯЗчАЁ ДйИЃАд ЙпРќЧЯДТ УЗДмБтМњЗЮ ДѕПэДѕ АЂЙкЧиСЎАЁАэ РЮАЃРЧ МўАэЧб СЄНХРЬ СЖБнОП ИХИєЕЧОю АЁДТ ЧіНУДыПЁ РЬ АјАЃРЬ РлРК ПЫДоЛљ ААРК АїРЬ ЕЩ Мі РжБтИІ БтДыЧбДй.

2016Гт 11Пљ

НТЧаЛъ РкЖєПЁМ БшСОПэ ОИ