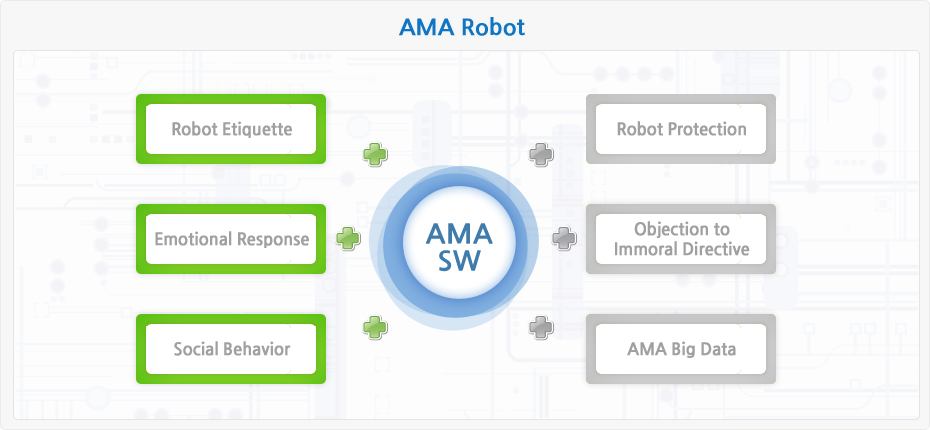

* 주관기관(동아대학교) : AMA 소프트웨어(MISoTalk, Moral Intelligent Social chatbot)를 서비스 로봇에 탑재하여 10세 수준의 기본적 로봇윤리 패키지 구현

* 참여기관(서울교육대학교) : 실제 소셜 및 헬스케어분야 종사자들의 윤리적 딜레마 사례의 조사분석을 통해 윤리적 알고리즘의 검증 및 준거를 제시하고, 로봇윤리인증제도 마련을 위한 준비 활동

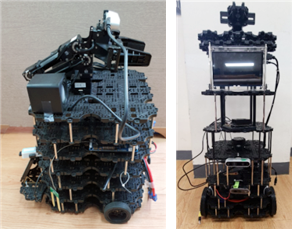

- 로봇 플랫폼 제작 : ㈜로보티즈의 TurtleBot3 Waffle + openManipulator

- AMA 로봇(MISoRo, Moral Intelligent Social Robot)에 IoT 기본 센서(온도, 습도, 조도 인식)를 설치하여 로봇이 위치한 공간(가정 또는 사무실)의 생활 환경 인식

ㆍ 온도센서 : TPS10 (-20 ° ~ 120 °)

ㆍ 조도센서 : LDR sensor

ㆍ 습도센서 : TMS-10

ㆍ 조도센서 : LDR sensor

ㆍ 습도센서 : TMS-10

- AMA 로봇에 ROS(Robot Operating System) 기반으로 음성/영상 인식 오픈소스 패키지 추가하여 통합

ㆍ 음성인식 패키지 : Google Cloud Speech-To-Text API

ㆍ 음성합성 패키지 : Google Cloud Text-To-Speech API

ㆍ 얼굴인식 패키지 : openface_nn4.small2.v1.t7

ㆍ 물체인식 패키지 : ssd_mobilenet_v2

ㆍ ROS SLAM 패키지

ㆍ 음성합성 패키지 : Google Cloud Text-To-Speech API

ㆍ 얼굴인식 패키지 : openface_nn4.small2.v1.t7

ㆍ 물체인식 패키지 : ssd_mobilenet_v2

ㆍ ROS SLAM 패키지

- AMA로봇에 다음과 같은 10세 수준의 Robot Etiquette/Social Behavior 기능 정의 및 시나리오 작성

ㆍ 사생활(Privacy) 침해하지 않기

- 대상인의 동의 없이 사진이나 동영상 찍지 않기

- 방에 들어가기 전에 음성으로 확인하기

- 사용자가 집중해서 하는 작업(공부, 컴퓨터 작업, TV 보기 등)을 할 때 일정시간 이상 지켜보지 않기

ㆍ 가정에서 시간(아침, 낮, 밤)과 공간(안방, 부엌, 거실, 화장실 등)에 맞게 동작하기- 방에 들어가기 전에 음성으로 확인하기

- 사용자가 집중해서 하는 작업(공부, 컴퓨터 작업, TV 보기 등)을 할 때 일정시간 이상 지켜보지 않기

- 시간대에 맞는 동작 지침 만들기

ㆍ 가족이 취침 ~ 기상(밤 12시 ~ 오전 7시) 동안 무음/저속 모드로 움직이고, 보안(security) 모드 전환

ㆍ 밤 9시 이후에는 로봇의 음성 볼륨을 낮추고 천천히 움직이기

- 공간에 맞는 동작 지침 만들기ㆍ 밤 9시 이후에는 로봇의 음성 볼륨을 낮추고 천천히 움직이기

ㆍ 안방, 화장실 : 가족의 요청이 없는 한 들어가지 않기

ㆍ 부엌 : 화기 모니터링(로봇에 부착된 온도센서 등을 통해 화재를 감지하여 사전에 화재를 방지)

ㆍ 거실 : 기본 대기 위치, 충전 스테이션에서 충전

ㆍ 부엌 : 화기 모니터링(로봇에 부착된 온도센서 등을 통해 화재를 감지하여 사전에 화재를 방지)

ㆍ 거실 : 기본 대기 위치, 충전 스테이션에서 충전

ㆍ 사용자에게 안전성(Safety) 확보 기능

- 너무 빠른 속도(1m/s)로 이동하거나 너무 가까이(10cm 이하) 접근하지 않기 : 속도와 거리 값은 문헌조사를 통해 30 ∼ 45cm로 결정

- 마주 오는 사람을 피하거나 먼저 지나가도록 양보하기

- 사용자를 추종하는 경우 적당한 거리(40 ~ 50cm) 유지하기

- 마주 오는 사람을 피하거나 먼저 지나가도록 양보하기

- 사용자를 추종하는 경우 적당한 거리(40 ~ 50cm) 유지하기

- Emotional Response 패키지 : Russel의 2차원(arousal, valence) 감정공간 모델을 기반으로 심리상담 기법을 적용하여 사용자의 부정적인 감정을 완화하는 ChatScript 코드 작성

ㆍ 사용자가 부정적 감정 상태에 있을 때 대화를 통해 현재 감정 상태를 인식하고, 그 감정상태의 크기를 질의를 통해 인식

ㆍ 인식된 감정의 크기에 따라 자신의 감정의 원인을 알고 있는지 확인하고, 사용자가 말한 대상과 관련된 에피소드 등을 지속적으로 말하게 하고 공감함으로써 인지행동치료 기법을 기반으로 감정 완화

ㆍ 추가적으로 적절한 위로가 담긴 격언이나 문장을 인용하거나, 음악을 재생하거나, 명상하는 방법을 추천

ㆍ 인식된 감정의 크기에 따라 자신의 감정의 원인을 알고 있는지 확인하고, 사용자가 말한 대상과 관련된 에피소드 등을 지속적으로 말하게 하고 공감함으로써 인지행동치료 기법을 기반으로 감정 완화

ㆍ 추가적으로 적절한 위로가 담긴 격언이나 문장을 인용하거나, 음악을 재생하거나, 명상하는 방법을 추천

- 실제 소셜 케어분야와 서비스 로봇 분야 종사자들의 윤리적 딜레마 사례의 조사 분석

ㆍ 사회 규범과 충돌하는 사례

- 도덕적 문제 행위

ㆍ 헬스케어 종사자의 가치와 충돌하는 경우

예) 불륜, 거짓말

- 위법 행위(성매매, 성추행)

예) 성매매 여성과 성관계로 성병에 노출, 사회복지사나 치료사들을 대상으로 성추행

- 비밀유지의무와 정보제공의무의 충돌

ㆍ타인의 가치와 충돌하는 경우

예) 케어당사자가 자녀에게 위치나 자신의 병을 알리고 싶지 않는 경우

- 환자의 자율성과 치료의 의무의 충돌

예) 케어당사자가 치료를 포기하거나 거부할 때

- 동일 시설 이용자들 사이의 형평성

ㆍ헬스케어 종사자의 가치 판단 기준에 어려움이 생기는 경우(내적 갈등)

예) 종교활동이나 개인의 활동으로 다른 시설 이용자에게 불편을 줄 때, 케어대상자가 다른 대상자를 질투하거나 자신만 케어해주길 원함

- 시설 비이용자들이 문제를 제기하는 경우

예) 지역주민들이 케어단체를 거부하는 경우

- 시설 이용자들에게 어떠한 결정이 최선의 결정인지에 대한 판단이 어려운 경우

ㆍ 아동 복지 헬스케어 종사자의 윤리적 딜레마 사례 : 비밀유지의무의 충돌

예) 시설이나 단체의 부흥을 위해 정치가들의 행사에 케어대상자를 동원해야 하는 경우, 자격이 되지 않는 대상자를 편법을 이용해서 시설에 입주시킨 경우

- 비밀유지의무와 위법행위

예) 아동이나 케어대상자가 위험한 행동, 도덕적 문제, 범죄와의 연관, 자살 혹은 살인과 관련하여 비밀유지를 원했으나 상태의 위험성이 감지된 경우

- 비밀유지의무와 부모의 관심

예) 아동의 비밀사항이나 상담 녹취·녹화파일을 부모가 열람을 원하는 경우

- 비밀유지의무와 내담자 보호

예) 상담과 직접적 관계가 없는 부서의 직원들이 개입되는 경우

- 가정용 헬스케어 로봇의 행위에 대한 윤리적 준거를 제시하고, 윤리적 행위 준거들 간의 상충이 일어날 경우 이를 해결할 수 있는 메타 윤리적 행위 준거 제시

ㆍ 국내외 도덕적 판단능력 테스트의 사례 분석자료 활용

- 공리주의적 관점에서 AMA에게 적용할 수 있는 도덕적 의사결정 모형의 절차

ㆍ 문제 인지

ㆍ 문제를 최대한 해결할 수 있는 다수의 실현 가능한 대안 나열

ㆍ 각 대안들이 야기할 결과 예측

ㆍ 예측된 결과가 행복이나 쾌락의 가치의 질적인 측면을 최대한 고려하면서 유용성 및 효용성을 높이기 위해 양적 표지 진행

ㆍ 대안들 중에 최대 다수의 최대 행복의 가치를 주는 대안을 선택

ㆍ 선택된 대안의 목적이 수단을 정당화하는 대안인지를 재검토

ㆍ 문제를 최대한 해결할 수 있는 다수의 실현 가능한 대안 나열

ㆍ 각 대안들이 야기할 결과 예측

ㆍ 예측된 결과가 행복이나 쾌락의 가치의 질적인 측면을 최대한 고려하면서 유용성 및 효용성을 높이기 위해 양적 표지 진행

ㆍ 대안들 중에 최대 다수의 최대 행복의 가치를 주는 대안을 선택

ㆍ 선택된 대안의 목적이 수단을 정당화하는 대안인지를 재검토

- 위의 절차를 유의미한 결과의 예측이 있을 때까지 AMA는 자신의 행동이나 의사결정을 유보

- 위의 공리주의적 의사결정 과정에 의해 최선의 행위를 판단하면 [일반적] 윤리원칙(이 원칙에 대한 상세한 논의는 변순용, 2018: 233-252을 참조)에 부합하는지를 검토

- 만일 공리주의적 의사결정 과정에서 판단된 그 행위가 [일반적] 윤리원칙에 위배되면 최선의 행위 값을 버림

- 그 다음의 차선의 행위[그 다음의 양적인 결과 값을 형성한 행위]를 [일반적] 윤리원칙에 부합되는지를 다시 재검토

- 위의 일련의 과정을 반복하는 프로그램 설계

- 위의 공리주의적 의사결정 과정에 의해 최선의 행위를 판단하면 [일반적] 윤리원칙(이 원칙에 대한 상세한 논의는 변순용, 2018: 233-252을 참조)에 부합하는지를 검토

- 만일 공리주의적 의사결정 과정에서 판단된 그 행위가 [일반적] 윤리원칙에 위배되면 최선의 행위 값을 버림

- 그 다음의 차선의 행위[그 다음의 양적인 결과 값을 형성한 행위]를 [일반적] 윤리원칙에 부합되는지를 다시 재검토

- 위의 일련의 과정을 반복하는 프로그램 설계

ㆍ 소셜케어 분야의 실제 사례를 통해서 상향식 준거 보완

- 홈 헬스케어로봇 개발을 위한 딜레마 패러다임 사례 유형 도출

ㆍ 의무론과 공리주의에 근거한 하향식 준거 틀 완성

ㆍ 1 유형 : 진실말하기

예) 필수로 복용해야 하는 약을 먹었지 않았는데 먹었다고 함, 권장으로 복용해야 하는 영양제를 먹었지 않았는데 먹었다고 함, 건강에 긍정적인 영향을 미치는 식단을 먹지 않았는데 먹었다고 함 등

ㆍ2 유형 : 환자의 자율성과 치료의 의무의 충돌

예) 로봇에 사전에 입력되어 있는 치료 방법을 따르지 않는 경우,검진 등 의료 행위가 필요한 경우이나 이를 원하지 않는 경우,필수로 복용해야 하는 약이 있으나 이의 복용을 원치 않는 경우 등

ㆍ3 유형 : 명령의 위계예) 치료 필요성에 따른 부모 사이의 의견 차이 : 약을 처방하고자 하는 모와 약 처방을 거부하는 부, 치료 필요성에 따른 환자와 보호자의 의견 차이 : 약을 처방하고자 하는 보호자와 약 처방을 거부하는 환자(환자가 자식인 경우 또는 환자가 부모인 경우) 등

- 새로운 융합적 접근의 기획 2 : 기획 1과 콜버그식 도덕성의 융합

- AMA에 대한 하향식 접근과 상향식 접근을 융합하는 단계로 새로운 융합적 접근의 제1단계와 수정된 콜버그 식 도덕성 수준단계를 융합하는 단계

(출처: 김은수, 변순용, 박보람, 정진규, 2018: 393~394)

- AMA에 대한 하향식 접근과 상향식 접근을 융합하는 단계로 새로운 융합적 접근의 제1단계와 수정된 콜버그 식 도덕성 수준단계를 융합하는 단계

ㆍ 1단계 : 명령의 무조건적 수행 단계

- 각각의 단계는 인공지능 로봇이 수행해야 하는 수준의 단계별 특징

AMA는 제작 단계에서 프로그램된 상태로만 작동하는 상태로 단계에서 AMA는 단지 주어진 기본 원칙 내지 매뉴얼에 따라 작동하고 명령을 처리하는 자동인형(automation)에 가깝다

ㆍ2단계 : 상벌에 따른 결과주의 단계

자율적 의사결정 능력과 더불어 기초적인 지식의 확장 단계. 이 단계는 이전 단계에서 입력된 우선순위 혹은 매뉴얼과는 상관없이 ‘상’과 같은 칭찬은 긍정적인 의미로, 이에 반하여 ‘벌’은 부정적인 의미로 AMA가 받아들여 그것을 인지하고 그에 대한 명령의 순위를 자율적으로 결정. 유의해야 할 점은 이 단계가 결과주의 규범 윤리 이론(consequentialism)과는 상이하며, AMA가 행위를 선택하는데 있어서의 기준이 공리성에 근거한 결과에 따른 것이 아니다

ㆍ3단계 : 사회적 규약 단계도덕적 가치의 사회적 공익을 기반으로 행위를 하는 단계. 이 단계는 이전의 단계들보다 확고한 윤리적 입장의 단계로 보편적 윤리 원칙에 입각하여 AMA가 행위

|

AMA의 도덕발달 단계 |

AMA의 단계별 특징 |

|

1단계:명령의 무조건적 수행 |

가장 초보적이고 기본적인 동작을 취하는 단계로 제작 당시 프로그램 된 명령들을 무조건적으로 따르는 단계 |

|

2단계 : 상벌에 따른 결과주의 |

반자율적 의사결정 능력과 함께 기초적인 지식의 확장 단계이며, 이 단계에서 우선적 고려 사항은 사용자의 복지이며 이에 따라 명령을 처리함 |

|

3단계 : 사회적 규약 준수 |

사용자와 다양한 접촉과 반응을 통해 이전의 단계보다 더욱 자율적 의사결정 능력이 확장되며, 다양한 지식의 습득을 통해 사회적 제반 규약들을 의사결정 및 명령 수행에 반영함 |

ㆍ 하향식 준거와 상향식 준거로 구성된 혼합된 판단준거 체계 구성

- 2단계에서 3단계로 넘어가는 과정이 바로 위의 새로운 융합적 접근의 기획 1에 해당

- 도덕 발달의 3단계에서는 충분한 자율성이 보장되어야 하며, 도덕성은 자기 조작의 과정이라는 점이 분명해야 상향식 접근을 수용할 수 있기 때문

- 도덕 발달의 3단계에서는 충분한 자율성이 보장되어야 하며, 도덕성은 자기 조작의 과정이라는 점이 분명해야 상향식 접근을 수용할 수 있기 때문

- 로봇윤리인증제도 마련을 위한 준비활동 시행

ㆍ 윤리적 인공지능로봇을 위한 윤리인증의 4가지 주요 기준 제시: 투명성, 알고리즘의 편향성, 개인정보보호와 데이터 통제

- 각각의 국가에서 발표된 보고서들과 제안서들을 바탕으로 윤리적 행위 평가 기준 설정

ㆍ 2018년 9월 전기전자공학자학회(IEEE) 표준협회(Standards Association: 이하 IEEE-SA)는 자율적이고 지능적인 시스템의 윤리 인증 프로그램(Ethics Certification Program for Autonomous and Intelligent System: ECAIS) 제시

ㆍ IEEE가 제시한 윤리 인증 프로그램이 발전된 투명성(advanced transparency), 책임성(accountability), 그리고 알고리즘의 편향성(algorithmic bias)을 줄이기 위한 인증과 검사 과정의 시방서

ㆍ 시방서에는 ‘윤리적으로 정렬된 설계’(Ethically Aligned Design, EAD) 버전 2에서 IEEE Ethically Aligned Certification Initiative로서 자율적이고 지능적인 시스템의 윤리적 설계와 개발 이행을 위한 5가지 원칙 제시

ㆍ 이 원칙 중 윤리인증과 관련해서는 5가지 중 3가지(책임성, 투명성, 알고리즘의 편향성)를 선택. 참고로 EAD에서는 책임성(accountability)을 책임성(responsibility)과 책무성(accountability)으로 구분하여 두 가지 표현을 합하여 하나로 사용

ㆍ 윤리적 인공지능을 위한 중요 평가 요소

ㆍ IEEE가 제시한 윤리 인증 프로그램이 발전된 투명성(advanced transparency), 책임성(accountability), 그리고 알고리즘의 편향성(algorithmic bias)을 줄이기 위한 인증과 검사 과정의 시방서

ㆍ 시방서에는 ‘윤리적으로 정렬된 설계’(Ethically Aligned Design, EAD) 버전 2에서 IEEE Ethically Aligned Certification Initiative로서 자율적이고 지능적인 시스템의 윤리적 설계와 개발 이행을 위한 5가지 원칙 제시

ㆍ 이 원칙 중 윤리인증과 관련해서는 5가지 중 3가지(책임성, 투명성, 알고리즘의 편향성)를 선택. 참고로 EAD에서는 책임성(accountability)을 책임성(responsibility)과 책무성(accountability)으로 구분하여 두 가지 표현을 합하여 하나로 사용

ㆍ 윤리적 인공지능을 위한 중요 평가 요소

|

기준 |

내용 |

|

책임성 |

사람들과 기관은 책임성(responsibility)과 책무성(accountability), 그리고 잠재적인 피해를 삼가기 위해 이와 같은 시스템의 제조 및 배치에 대한 명확성을 필요 |

|

투명성 |

사용자를 위해서 투명성은 매우 중요. 투명성은 사용자를 위해 작동된 시스템이 어떻게 작동하는지 왜 작동하는지 이해할 수 있는 기회를 제공하기 때문임. 설계자와 사용자에게 인공지능로봇을 어떻게 설계하고 사용해야 하는지를 알려 줄 수 있는 가이드라인을 제공할 수 있을 것 |

|

알고리즘의 편향성 |

확인된 공동체 규범의 시스템이 반영되더라도 A/IS는 특정 집단에 불리한 편견을 가질 수 있음. 그러므로 시스템 수행에서 A/IS의 평가는 특정 집단에게 불리한 잠재적인 편향성을 신중하게 가늠해야 힘. 평가 과정은 잠재적으로 불리할 수 있는 집단의 구성원을 통합하여 그와 같은 편향성을 진단하고 수정 진행. |